|

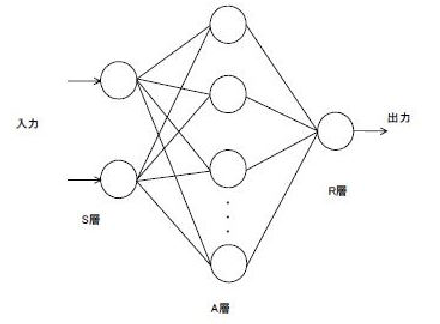

パーセプトロンの構造を図 3.1に示す。パーセプトロンは3層からなるネットワークである。

その層は ![]() 層(Sensory unit)、

層(Sensory unit)、![]() 層(Associative unit)、および

層(Associative unit)、および ![]() 層(Response unit)と呼ばれる。

ネットワークの入力から出力にいたるまで、信号の流れは単一方向である。また各層のニューロン数は制限されない。

層(Response unit)と呼ばれる。

ネットワークの入力から出力にいたるまで、信号の流れは単一方向である。また各層のニューロン数は制限されない。

![]() 層は入力信号をそのまま通過させるニューロンである。

層は入力信号をそのまま通過させるニューロンである。![]() 層と

層と![]() 層のニューロンは活性化関数としてステップ関数を持つマカロック・ピッツモデルである。

このようにフィードバックや相互結合を持たないようなネットワークは一般的に階層構造ネットワークと呼ばれる。

したがって、パーセプトロンは図 3.2のような階層構造ネットワークの一つである。

階層型は、入力層と中間層、そして出力層で構成される。

各層の ニューロン数に制限はなく、中間層の層数も制限は無い。

層のニューロンは活性化関数としてステップ関数を持つマカロック・ピッツモデルである。

このようにフィードバックや相互結合を持たないようなネットワークは一般的に階層構造ネットワークと呼ばれる。

したがって、パーセプトロンは図 3.2のような階層構造ネットワークの一つである。

階層型は、入力層と中間層、そして出力層で構成される。

各層の ニューロン数に制限はなく、中間層の層数も制限は無い。

信号の流れを説明する。まず入力信号はS層を通過し、![]() 層からの信号を

層からの信号を![]() 層に伝達するが、このとき

層に伝達するが、このとき![]() 層と

層と![]() 層の結合に重みがかかっている。

層の結合に重みがかかっている。

![]() 層のニューロンでは、

層のニューロンでは、![]() 層の出力とこの重みの加重和がとられ、その和と閾値を比較することで出力を得る。

層の出力とこの重みの加重和がとられ、その和と閾値を比較することで出力を得る。

こうして得た ![]() 層の出力が

層の出力が![]() 層の入力となるが、

層の入力となるが、![]() 層への入力は、

層への入力は、![]() 層と

層と![]() 層の結合の重みの加重和と閾値の比較で

層の結合の重みの加重和と閾値の比較で![]() 層のニューロンの出力が決定され、その値がネットワークの出力値となる。図 3.3と図 3.4にネットワークの計算例を示す。

層のニューロンの出力が決定され、その値がネットワークの出力値となる。図 3.3と図 3.4にネットワークの計算例を示す。

図 3.3は ![]() 層から

層から ![]() 層の計算、図 3.4は

層の計算、図 3.4は ![]() 層から

層から ![]() 層の計算を示している。

ネットワークは

層の計算を示している。

ネットワークは ![]() 層、

層、![]() 層、

層、![]() 層はそれぞれ3つのニューロンで構成されている。また

層はそれぞれ3つのニューロンで構成されている。また ![]() 層と

層と ![]() 層の活性化関数の閾値は0であるとする。

層の活性化関数の閾値は0であるとする。

今S層( ![]() 、

、![]() 、

、![]() )に101という入力を与えたとする。S層のニューロンは入力値をそのまま出力する。

この値が

)に101という入力を与えたとする。S層のニューロンは入力値をそのまま出力する。

この値が ![]() 層(

層( ![]() 、

、![]() 、

、![]() )の入力となる。

図 3.3 は

)の入力となる。

図 3.3 は ![]() のみの計算を示している。

のみの計算を示している。![]() 層と

層と ![]() の結合の重みが

の結合の重みが ![]() ,

, ![]() ,

, ![]() である。

である。

その結果、加重和 ![]() は

は

となる。![]() は閾値を上回っているので、

は閾値を上回っているので、![]() の出力は1となる。

の出力は1となる。![]() と

と ![]() の出力も同様に求められる。

の出力も同様に求められる。

図 3.4は ![]() 層にあるニューロン

層にあるニューロン ![]() についての計算例を示している。

についての計算例を示している。

![]() を求めたものと同様に

を求めたものと同様に ![]() 、

、![]() を求め、その結果

を求め、その結果 ![]() 層(

層( ![]() 、

、![]() 、

、![]() )の出力がそれぞれ

)の出力がそれぞれ ![]() となったと仮定する。

この値が

となったと仮定する。

この値が ![]() 層の入力となり、

層の入力となり、![]() 層と

層と ![]() 層の結合の重みの加重和と閾値で

層の結合の重みの加重和と閾値で ![]() 層の出力を決定する。

層の出力を決定する。

図 3.4において、![]() 層と

層と ![]() の結合の重みが

の結合の重みが ![]() ,

, ![]() ,

, ![]() であるとすると、加重和

であるとすると、加重和 ![]() は

は

となり、閾値を下回るのでニューロン ![]() の出力は0となる。

の出力は0となる。![]() と

と ![]() も同様にして求められる。

も同様にして求められる。

本実験では学習させる対象として時系列を用いているが、 時系列は過去の情報から未来の情報が決定し、 その情報でさらに次の未来の情報を決定するという時間的な方向性を持つ。 そのため、結合の形状に方向性のある 階層型のネットワークを使うこととした。