今回の実験で用いる畳み込みニューラルネットワークは、5.3に示したMNISTを用いた畳み込みニューラルネットワークをもとに構築する。

5.3からの変更点を挙げていく。

- 今回用いるデータは

サイズ、2チャンネルで構成されているため、第1畳み込み層に入力する際のデータサイズを調整する。

サイズ、2チャンネルで構成されているため、第1畳み込み層に入力する際のデータサイズを調整する。

- MNISTの畳み込み処理では、

サイズのフィルタを適用して畳み込み処理を行っていたが、今回のデータでは第1プーリングを行った時点でデータサイズが

サイズのフィルタを適用して畳み込み処理を行っていたが、今回のデータでは第1プーリングを行った時点でデータサイズが 、32チャンネルのデータとなり、

、32チャンネルのデータとなり、 サイズのフィルタを適用することができないため、

サイズのフィルタを適用することができないため、 サイズのフィルタを適用する。

サイズのフィルタを適用する。

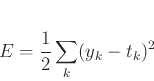

- MNISTの例はいわゆる分類問題であり、オセロの局面評価は回帰問題である。そのため、出力層の数は1つとなる。これに際して、損失関数として2乗和誤差(mean squared error)を用いる。

ニューラルネットワークの出力を

、教師信号を

、教師信号を とすると、2乗和誤差は式(6.2)で表される。

また、最適化には最急降下法を用いる。

とすると、2乗和誤差は式(6.2)で表される。

また、最適化には最急降下法を用いる。

|

(26) |

Deguchi Lab.

2017年3月6日