Next: 実験

Up: 学習

Previous: ニューラルネットワークにおける学習

目次

逐次学習法

逐次学習法は,今回カオスニューラルネットワークの学習に用いる学習方法で,入力がひとつ入るたびに逐次的に学習を行っていくものである。これを用いることで,カオスニューラルネットワークで連想記憶を実現することができる。ここで実現される連想記憶というのは,ニューラルネットワークが,いくつかのパターンを記憶するということである。具体的には,記憶済みのパターンが入力されると,それを連想して想起し,全く同じパターンを出力する。記憶できていないパターンが入力されると,それを記憶できるように学習が行われる。

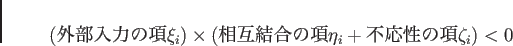

逐次学習は式(3.5)で示したカオスニューロン内部状態を表す三つの項,外部入力の項  ,相互結合の項

,相互結合の項  ,不応性の項

,不応性の項  において,ある条件が満たされたとき学習を行なう。その条件式は式(4.1)で表される。

において,ある条件が満たされたとき学習を行なう。その条件式は式(4.1)で表される。

|

(4.1) |

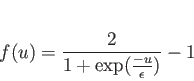

この条件式は,相互結合の項と不応性の項の和と外部入力の項との積が負の時に,積が正になるまで結合荷重を変化することで学習することを表している。積が正であるか負であるかを判定できるようにするために,逐次学習法で用いる出力関数は式(4.2)のものを使用する。

|

(4.2) |

結合荷重の変化は相互結合の項のみに影響を与える。相互結合の項が外部入力の項の符合と同じになることにより,相互結合の項によってネットワークのエネルギーが極小値に向かっていこうとする力と,外部入力によって入力されたパターンに近付こうとする力が同じ方向に働く。それにより同じパターンが入力された時すばやく想起できるようになる。また,式 (4.1) が成立し,ある程度時間が過ぎると外部入力の項と反対の符号を持つ不応性の項の値が大きくなっていく。それにより,不応性の項の絶対値が,外部入力の項の絶対値を越えると,再び条件式が成り立ち,外部入力の項の絶対値が不応性の項の絶対値を越えるように再び学習が始まる。これを繰り返すことにより学習をより強めていく。

式 (4.1) が成り立つとヘッブの原理に沿って結合荷重を変化させる。 番目のニューロンの

番目のニューロンの  番目のニューロンからの出力に掛かる結合荷重

番目のニューロンからの出力に掛かる結合荷重  の変化は式(4.3) で表される。

の変化は式(4.3) で表される。

![\begin{displaymath}

w_{ij}= \left\{

\begin{array}{@{\,}ll}

w_{ij} + \Delta w &\m...

...&\mbox{[$ \xi_i(t) \times x_j(t-1) \le 0$]}

\end{array}\right.

\end{displaymath}](img65.png) |

(4.3) |

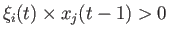

であるとき,

であるとき, 番目のニューロンに出力させたい値と

番目のニューロンに出力させたい値と 番目のニューロンの出力が同じ向きであるため,結合荷重値を

番目のニューロンの出力が同じ向きであるため,結合荷重値を 分加算して,

分加算して, 番目のニューロンが

番目のニューロンが 番目のニューロンの出力を,自分の出力と一致させようとする働きを強める(協調作用)。

番目のニューロンの出力を,自分の出力と一致させようとする働きを強める(協調作用)。

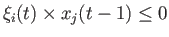

であるとき,

であるとき, 番目のニューロンに出力させたい値と

番目のニューロンに出力させたい値と 番目のニューロンの出力が逆の向きであるため,結合荷重値を

番目のニューロンの出力が逆の向きであるため,結合荷重値を 分減算して,

分減算して, 番目のニューロンが

番目のニューロンが 番目のニューロンの出力を,自分と異なる方向にしようとする働きを強める。

番目のニューロンの出力を,自分と異なる方向にしようとする働きを強める。

なお,自分自身へのフィードバックはないため, である。

である。

Deguchi Lab.

2016年3月1日

![]() ,相互結合の項

,相互結合の項 ![]() ,不応性の項

,不応性の項 ![]() において,ある条件が満たされたとき学習を行なう。その条件式は式(4.1)で表される。

において,ある条件が満たされたとき学習を行なう。その条件式は式(4.1)で表される。

![]() 番目のニューロンの

番目のニューロンの ![]() 番目のニューロンからの出力に掛かる結合荷重

番目のニューロンからの出力に掛かる結合荷重 ![]() の変化は式(4.3) で表される。

の変化は式(4.3) で表される。

![]() である。

である。